Oma wird nicht überfahren

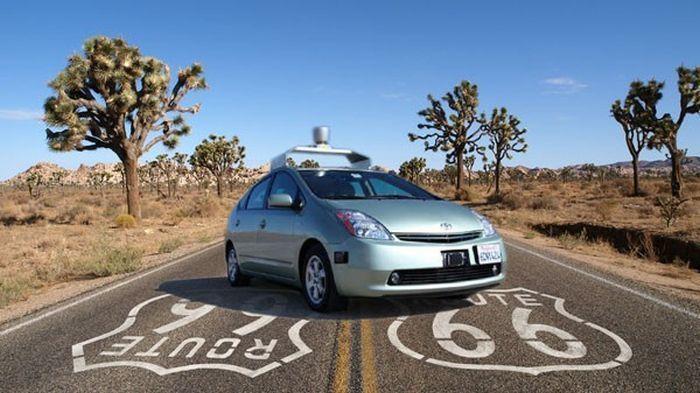

Oma oder Kind? Bild: erincj338/CC-BY-SA-2.0

Bei Vorträgen über autonome Fahrzeuge wird fast immer gefragt, ob im Fall der Fälle das fahrerlose Auto eher die alte Frau als das kleine Kind überfahren würde. Können Roboterautos ethische Entscheidungen treffen? Sollten sie?

Im vergangenen Jahr sind in Europa mehr als 26.000 Menschen bei Verkehrsunfällen umgekommen. Dazu gab es noch 135.000 Schwerverletzte. Während in der EU jährlich 51 Verkehrstote pro 1 Million Einwohner zu beklagen sind, schneidet Deutschland etwas besser mit 43 Todesfälle ab. Den ersten Platz bei der Verkehrssicherheit belegen jedoch die Schweden mit nur 27 Toten pro Million Einwohner. Einer der Hauptgründe für die Einführung von Fahrassistenzsystemen ist, die Anzahl der Verkehrsunfälle nachhaltig senken zu können. Die Firma Volvo spricht beispielsweise von zukünftigen Autos, in denen kein Passagier mehr tödlich verunglücken kann, da die aktive und passive Sicherheit des Fahrzeugs ausreichenden Schutz für alle Insassen bieten wird.

Es verhält sich anders, wenn man die schwächeren Verkehrsteilnehmer berücksichtigt. Sensoren am Fahrzeug können Fahrradfahrer und sogar Passanten erkennen, aber nicht bei allen vorstellbaren Unfallszenarien. Gegen den Passanten, der zwischen zwei geparkten Bussen auf die Straße rennt, sind weder Kraut noch Sensor gewachsen. Deshalb zerbrechen sich die Autoingenieure den Kopf darüber, wie sogar solche Personen frühzeitig erkannt werden könnten, womöglich unter Ausnutzung des Funksignals ihrer Handys oder mit Hilfe der Videokameras von anderen Fahrzeugen, die dann die akute Gefahr melden. Wie dem auch sei, es ist wohl klar, dass auch in Zukunft manche Arten von Verkehrsunfällen nicht vermieden werden können. Die Frage ist also, wie man dennoch die Folgen minimieren kann.

Bei Vorträgen über die von meiner Gruppe entwickelten autonomen Fahrzeuge wird deswegen immer gefragt, welche Alternative das autonome Fahrzeug bei einem unvermeidlichen Unfall wählen würde, bei dem es nur die Entscheidung gäbe, in der einen Spur ein Kindoder in der Nachbarspur eine alte Frau zu überfahren. Anders gesagt: Kann das Fahrzeug ethische Entscheidungen treffen und sich womöglich für die Rettung des Kindes entscheiden, wodurch die alte Frau dran glauben würde? Kurioserweise ist bei solchen Fragen das Opfer immer weiblich, niemals ein älterer Herr (und meistens stellt ein Mann die Frage).

Auf eine solche Frage in kurzer Zeit eingehen zu können ist für mich immer undankbar, besonders wenn noch dazu ein Philosoph in der Diskussionsrunde sitzt und er oder sie von Maschinen eben ein solches ethisches Gewissen eindringlich verlangt. Dass die Technik noch keineswegs ein solches Niveau erreicht hat, wollen diese Gesprächspartner nicht wahrhaben. Von einer allwissenden Philosophin wurde ich bei einer solchen Diskussionsrunde bereits über Fahrzeug-Kantianismus belehrt. Deswegen veröffentlche ich meine Stellungnahme hier auf Telepolis, wo man auf der Suche nach Veritas Argumente in Ruhe am grünen Tisch ausbreiten kann.

Menschen und der ethische Zusammenbruch

Vorher muss man jedoch eine Legende demontieren, nämlich die, dass sich Menschen bei solchen Verkehrsszenarien bzw. Unfallsituationen ethisch verhalten. Das beste Beispiel dagegen sind in Not geratene Flugzeuge. Wie oft liest man, dass ein kleines Verkehrsflugzeug auf der Autobahn gelandet ist? Auf die Idee auf dem Acker bzw. Wasser zu landen kommen die wenigsten, da sie primär an die eigene Rettung und nicht an die bis dahin unbeteiligten Autofahrer denken. Folgende Beispiele mögen zeigen, wie Menschen sich in Extremsituationen verhalten:

- Im Jahr 2014 sind ein Mann und seine Tochter am Strand von Florida von einem landenden Flugzeug getötet worden. Pilot und Flugzeugpassagier blieben unverletzt.

- Erst im vergangenen April ist ein Flugzeug auf die Autobahn in Kalifornien gelandet. Eine Frau starb in ihrem Fahrzeug und drei weitere Personen, die nicht im Flugzeug saßen, wurden verletzt.

- In Südafrika versuchte 2011 ein Flugzeug auf der Autobahn zu landen und erfasste dabei ein Auto. Nur die Insassen des Flugzeugs starben.

- Im Jahr 1987 landete ein Cargoflugzeug mit 18 Pferden und 12 Personen auf der Autobahn zwischen Mexico City und Toluca zur Rushhour. Bis zu 39 Personen starben und eine Tankstelle, die vom landenden Flugzeug gestreift wurde, explodierte. Pilot und Copilot, beide US-Bürger, überlebten. Vier Häuser und 26 Autos gingen in Flammen auf.

Solche Beispiele veranschaulichen, was in einem anderem Kontext "ethischer Zusammenbruch" genannt wird. Es ist auch nicht so, dass die Piloten solcher Flugzeuge nur wenige Sekunden für ihre Entscheidung gehabt hätten. Meistens geschieht eine solche Landung im Gleitflug und es vergehen manchmal Minuten.

Es gibt auch das Problem von Menschen, die sich für einen Suizid entscheiden. Verkehrsmittel werden dann zur Waffe, die sie gegen sich selbst aber leider auch gegen Unbeteiligte einsetzen. Es gibt Fahrer, die ihren Selbstmord durch eine Frontalkollision mit anderen Fahrzeugen erzwingen wollten. Am tragischen Fall der German Wings Maschine, die in Frankreich 2015 verunglückt ist, erinnern sich wahrscheinlich noch die meisten Leser.

Man könnte natürlich sagen, dass es sich hier um psychisch instabile Personen handelt, für die ethische Grenzen des eigenen Handelns verwischt seien. Was kann man aber von Autofahrern sagen, die regelmäßig und ohne jegliche Not die maximale Geschwindigkeit bei weitem übertreffen? Im Jahr 2014 gab es im Straßenverkehr in Deutschland 45.000 Unfälle mit Personenschaden, die auf überhöhte Geschwindigkeit zurückzuführen waren. Hierzulande bleibt überhöhte Geschwindigkeit Unfallursache Nummer 1. Bis zu 27% der Toten im Straßenverkehr sind daher auf zu schnelles Fahren zurückzuführen. Wer kennt aber nicht jemanden, der sich per Navigationssystem über die Radarfallen in der Stadt informieren lässt, um so überall schneller als erlaubt fahren zu können? Haben Sie mit der Person je ein ethisches Gespräch geführt?

Und der ADAC! Als der SPD-Vorsitzende Sigmar Gabriel ein generelles Tempolimit für die Autobahnen vorschlug, bemühte der ADAC die europäische Statistik, um zu zeigen, dass man in Deutschland weniger riskant fährt. Sie vergleichen dann gerne Äpfel mit Birnen, wenn es im Sinne der freien Fahrt für freie Bürger sein muss. Auf die einfache Idee, das Rasen generell zu unterbinden und sozial zu ächten, weil dieses sich auf die Straßen in der Stadt überträgt, kommt der ADAC nicht.

Vor Jahren hat jemand vorgerechnet wie viele Stunden alle Fahrer in Deutschland verlieren würden, wenn es Geschwindigkeitsobergrenzen auf allen Autobahnen gäbe. Teilt man jene Zahl durch die Stunden eines Lebens, ergibt sich die Anzahl der "virtuellen Toten", die wir natürlich durch einen Verzicht auf das Tempolimit vermeiden wollen. Die Berechnung kommt mir genauso dubios vor, wie die von der Firma Philip Morris für die Tschechische Republik. Die Anwälte von Philip Morris haben nämlich berechnet, wie viel die Regierung für die Behandlung von Lungenkrebskranken ausgibt, aber auch wie viel sie andererseits durch frühere Todesfälle an Renten spart. Unter dem Strich ergab sich für die Staatskasse ein "Gewinn" aus dem Rauchen.

Wie die Beispiele mit den Flugzeugen zeigen, ist bei einer unvermeidlichen Unfallsituation die erste Reaktion vieler Menschen, zuallererst die eigene Haut zu retten. Selten, vielleicht nie, wird ein Fahrer den Abgrund am Rande einer Bergautobahn ansteuern, wenn er plötzlich eine Gruppe entgegenkommenden Fahrradfahrer sieht. Menschen sind, in den meisten Fällen, nicht so selbstlos gestrickt.

Passive und aktive Sicherheit

Bevor wir auf die wehrlose Oma mitten in der Spur zurückkommen, müssen wir einige Überlegungen zur Autosicherheit los werden.

Wie die Unfallstatistik zeigt, kann man durch Verringerung der Geschwindigkeit die Folgen eines Unfalls reduzieren. Die kinetische Energie, die ein Fahrzeug besitzt, ist proportional zum Produkt des Quadrats der Geschwindigkeit und der Masse. Da Fahrzeuge viel zu schnell fahren können, brauchen sie ein ausreichendes Polster für Kollisionen. Man könnte sie aber viel leichter bauen, wenn man Konzepte für Stadtfahrzeuge entwickeln wurde, die langsamer fahren.

Reduziert man die maximale Geschwindigkeit in der Stadt um 50%, reduziert man damit die Energie eines aufprallenden Fahrzeugs um 75%. Dazu kommt die Reduzierung der Masse des Vehikels, das dann keine so große Polsterung braucht. Solche Konzepte für Stadtfahrzeuge (people movers bzw. shuttles) werden gegenwärtig von Universitäten und kleinen Startups vorgeschlagen. Die sogenannte "passive Sicherheit" ist in solchen Vehikeln automatisch gegeben.

Würde man dann jedoch zu viel Zeit im Verkehr verlieren? Nicht in Mexico Stadt: Dort beträgt die mittlere Geschwindigkeit eines Fahrzeugs (in der Woche, während der Arbeitszeit) sage und schreibe 7 Km/h. In Berlin beträgt sie 24 Km/h, wobei sie in der Innenstadt viel niedriger ist.

Kann man also langsamer fahren und trotzdem schneller ankommen? Ja, durch die Verringerung der Anzahl von Fahrzeugen, die sich außerdem mit dem öffentlichen Verkehr koordinieren können, und durch "car sharing on demand", damit die Durchschnittsbelegung der Autos deutlich über die aktuellen 1,3 Insassen pro Fahrzeug steigen kann.

Hinter der Entwicklung von autonomen Fahrzeugen steht deswegen, zumindest für mich, eine doppelte Motivation: Erhöhung der Sicherheit des Fahrzeugs, das über rundum hochpräzise Sensorik den Verkehr besser als ein Mensch erfassen kann (aktive Sicherheit), und die Transformation des Automobils in fahrerlose Taxis, die von Passagieren gemeinsam benutzt werden können, statt die Autos 95% der Zeit am Straßenrand stehen zu lassen. Diese Utopie für die Stadt habe ich bereits einmal in Telepolis erläutert (Autopie: Autonome Fahrzeuge für Car-Sharing). Das ist die einzige vernünftige Lösung für eine Megalopolis wie Mexiko-Stadt, wo die in jedem Moment fahrenden Autos, Stoßstange an Stoßstange, 5.000 Autobahnkilometer füllen würden.

Zusammenfassend wäre die Vision für autonome Fahrzeuge folgende: Erstens, wir bräuchten in der Stadt viel weniger Autos, wenn diese gemeinschaftlich benutzte Taxis wären und sich optimal mit den öffentlichen Verkehrsmitteln koordinieren könnten. Zweitens, wir können die Höchstgeschwindigkeit dann drastisch reduzieren, wodurch wir die Fahrzeuge automatisch sicherer machen könnten, da die Aufprallenergie deutlich zurückgehen würde. Trotzdem kämen wir alle schneller als heute ans Ziel, da der Verkehr wieder fließen würde.

Die vorhandenen Fahrzeuge könnten sich auch per Telekommunikation verständigen und eine "kollektive Fahrintelligenz" schaffen. Wenn ich außerdem im Fahrzeug lesen, mit dem Computer arbeiten oder sogar schlafen kann, dann ist die Zeit im Verkehr kein Problem. Die unproduktive Zeit des Selberfahrens verwandelt sich dann in Zeit für mich selbst.

Und die Oma?

Der ungeduldige Leser mag sich nun fragen, wo die verflixte Oma bleibt. Ich komme langsam zum Ziel. Drei Antworten hätte ich auf das ethische Beispiel mit Oma und Kind.

Erstens: Wie häufig hat man mit einem solchen Szenario zu tun? Ich würde mich außerordentlich wundern, wenn nur ein einziger von den tausenden Telepolis-Lesern jemals im Leben vor der Wahl stand, entweder die Oma oder das Kind zu überfahren. Wer so was einmal selbst erlebt hat, der möge sich bei den Kommentaren melden und seine Geschichte (und Entscheidung) erläutern. Ich denke, aus diesem Grund kommt das Szenario nicht bei den Führerscheinfragen vor (zumindest nicht in Berlin).

Zweitens: Die Realität ist, dass wir sehr weit von der Utopie entfernt sind. Das bedeutet, dass wir bei der Entwicklung von autonomen Fahrzeugen noch in den Kinderschuhen stecken. Wir alle, auch Google. Wir sind einfach froh, wenn wir mit den vorhandenen Sensoren die Präsenz von Hindernissen und deren Trajektorien erkennen. Wir sind sehr glücklich, wenn wir 99% der Passanten detektieren - die restlichen 1% werden noch viel Arbeit bedeuten.

Wir stehen am Anfang der Entwicklung - und jetzt von solchen Prototypen zu erwarten, in einer halben Sekunde das Alter der Passanten zu ermitteln, die Lebenserwartung zu berechnen (durch Blick auf die Patientenakten?) und dann sich für das Verschonen des Kindes zu entscheiden, ist etwas, was noch nicht auf der Tagesordnung der technischen Entwicklung steht. Es wäre so verfrüht, wie bereits heute für eine zukünftige Marsmission im Jahr 2050 die Immobiliengesetze für eine Marskolonie zu verabschieden.

Außerdem: Auf absehbare Zeit werden Prototypen von autonomen Fahrzeugen noch nicht fahrerlos zirkulieren. Mindestens ein Mensch wird drin sitzen und die Verantwortung tragen.

Und drittens: Es ist in Deutschland verboten Menschenleben gegen Menschenleben aufzurechnen! Das Bundesverfassungsgericht hat 2012 entschieden, dass es rechtswidrig wäre, automatisch ein gekapertes Passagierflugzeug abzuschießen, weil dann das Leben der Passagiere mit dem Leben der möglichen Opfer eines Absturzes verglichen würde, aber "Menschenleben nicht gegeneinander aufgerechnet werden dürfen". Steht also das Kind in der Spur und würde ein autonomes Fahrzeug sich für den Spurwechsel Richtung Oma entscheiden, hätte der Programmierer des Fahrzeugs etwas eingebaut, das in Deutschland einfach rechtswidrig ist. Ausschließlich Vollbremsung ist in allen solchen künstlichen Szenarien, ohne Möglichkeit des Ausweichens, angesagt.

Weniger Unfälle durch Tempolimit und Stadtplanung

Ich habe sehr interessante Vorträge von Verkehrsplanern gehört, bei denen es darum geht, das Verhalten der Autofahrer und Passanten durch reine Baumaßnahmen zu beeinflussen. In Holland ist es beispielsweise in manchen Städten gelungen, den Verkehr flüssiger zu machen, bei gleichzeitiger Reduzierung der Verkehrsunfälle.

Ich denke, dass wir in Zukunft, wenn Autos von alleine fahren können, wir diese auf Parkhäuser verbannen und die Straße größtenteils zurück an die Fußgänger und Fahrradfahrer geben können. Wenn wir dann keine geparkten Autos mehr hätten, wüchse automatisch der Platz für die heute sogenannten schwächeren Verkehrsteilnehmer. Wenn wir deutlich weniger Autos hätten, die auch nur noch Tempo 30 in der Stadt fahren, und dennoch schneller ans Ziel kommen, reduzieren wir auch das Unfallrisiko und die Unfallfolgen. Wenn die Straßen so ausgelegt werden, z.B. durch ausreichende Bepflanzung, dass die Passanten es jederzeit bevorzugen, die Straße nur an den Kreuzungen zu überqueren, hätten wir das Unfallrisiko nachhaltig deutlich reduziert.

Da bei Tempo 30 die Bremstrecke bei Vollbremsung 4,5m beträgt, müsste die Oma wirklich flink sein, um bei Sensoren mit 100 Metern Reichweite urplötzlich und ungesehen mitten auf der Spur zu stehen. Wäre dies trotzdem der Fall und würde auch ein ebenso flinkes Kind auf die Spur springen, und gäbe es keine andere Ausweichmöglichkeit, würde die Automatik einfach voll auf die Bremsen treten, ohne Menschleben gegeneinander aufzurechnen. Ist das Auto leicht gebaut und ist ausreichender passiver Schutz in der Karosserie verbaut worden, hätte man die maximale Vorsorge im Lichte der geltenden Gesetze getroffen.

Man könnte noch einwenden, dass Autos auf der Autobahn schneller sein werden, aber dort würde ich keine Oma mit Gehhilfe mitten auf der Spur erwarten. Größere Vehikel, wie z.B. Busse, sind natürlich gefährlicher, aber diese würden nicht überall zirkulieren und man könnte die Busspuren durch bauliche Maßnahmen zusätzlich absichern.

Ich denke: Wenn wir es richtig hinkriegen, werden weder Kind noch Oma überfahren.

Maschinen sind keine ethische Wesen

Aber ich will dem Hauptproblem nicht ausweichen. Die Frage wäre, ob wir nicht ethische Regeln in die Maschinen einprogrammieren sollten, z.B. Asimovs Gesetze oder meinetwegen die gesamte Ethik von Kant.

Um eine Antwort geben zu können, muss man ein Missverständnis aus dem Weg räumen. Wenn wir über "autonome Roboter" reden, meinen wir damit nicht, dass sie wirklich alles von alleine entscheiden. Computer tun nur das, was ihnen einprogrammiert wurde. Computer und Roboter sind unsere Sklaven und sie werden es bleiben, wahrscheinlich für immer. Wenn ein Roboter eine Entscheidung trifft, wurde diese eigentlich vom Programmierer selbst von vorne herein und durch das Regelwerk festgelegt. Es ist sicherlich schwierig, alle Auswirkungen von Regeln zu durchschauen und zu "debuggen", aber das ist des Informatikers Job.

Ein Programmierer sollte also nur das programmieren, was das Recht erlaubt und vorgibt. Das wäre im Fall von Autos bereits ein Vorteil. Unsere Erfahrung beim autonomen Fahren ist, dass wir die einzigen sind, die das Tempolimit (wenn vorhanden) auf der Autobahn einhalten. Wir fahren auch nicht Slalom auf der Straße und warten geduldig bis es ausreichend Platz für einen Spurwechsel gibt. Etliche Autofahrer missachten dagegen andauernd die Verkehrsregel. Würden nur Roboterautos fahren, könnte man die Einhaltung aller Verkehrsregel garantieren (vergessen Sie bitte nicht, es ist meine Utopie).

Steht also das autonome Fahrzeug vor Oma und Kind, wird das Auto das tun, was im Regelwerk steht. Gibt das vorhandene Recht eine Anleitung, dann ist es dies, was das Programm tut. Im Zweifelsfall entscheidet ein Mensch, d.h. der Programmierer. Was im Code steht und ausgeführt wird, ist dann die ethische Entscheidung dieses Programmierers. Philosophen mögen sich, falls gewünscht, wochenlang treffen, debattieren und Regeln vorschlagen, diese werden dann zum Regelwerk hinzugefügt.

Manche Leute denken dennoch, Computer wären durch "künstliche Intelligenz" bereits so weit, dass sie tatsächlich selbständig Probleme abwägen und alleine entscheiden können. Das ist nur die Illusion eines Außenstehenden. Der Programmierer weiß, wie das Regelwerk aussieht. Ergibt sich eine Fehlhandlung, muss der Fehler behoben werden. Deswegen wird man viele autonome Fahrzeuge vorher in Fahrten mit Millionen von kollektiv absolvierten Kilometern testen, bevor man sie auf die Straße bringt.

Man könnte einwenden, manche Programme, die z.B. maschinelles Lernen einsetzen, können sich selbst ändern und dann Entscheidungen treffen, die keiner mehr im Voraus absehen kann. Solche Programme wären allerdings verboten, wenn sie die Entscheidungen auf der obersten Ebene der Handlungen unvorhersehbar verändern könnten. Man möchte auch kein Kernkraftwerk haben, dessen Steuerung sich jeden Tag, von niemandem kontrollierbar, neu anpasst.

Während also maschinelles Lernen für die Ebene der Sensorik und Objekterkennung wohl Sinn macht (und statistisch überprüft werden kann), hat sie auf der deliberativen Ebene keinen Platz, wo das Regelhandwerk für die Einhaltung der Verkehrsregeln bearbeitet wird. Das ist eine Ebene, wo nur Menschen Entscheidungen treffen sollten und diese durch staatliche Zertifizierung absichern müssten.

Mir ist bewusst, dass es möglich wäre durch Regeln eine Art "toy ethics" in eine Maschine einzubauen, die aber keine echte Ethik wäre, weil sie von keinem verantwortungsvollen Subjekt interpretiert werden kann. So, wie ein Buch mit der Verfassung kein moralisches Wesen ist, nur weil in seinem Inneren die Verfassung ruht, so kann keine Software ein moralisches Wesen sein, da Selbstbewusstsein und Bewusstsein für die Handlungen und deren Folgen eine Voraussetzung jeder Form von Ethik ist.

Wir brauchen deswegen ethische Menschen, moralische Wesen, die gute Entscheidungen treffen. Maschinen sollen und können das nicht für uns tun. Die Ethik eines Roboters ist die Ethik seines Programmierers. Auch Roboter für den Krieg spiegeln die Ethik ihres Erbauers wieder. Sie selber sind nur Metall und Chips, leblose maschinelle Sklaven, die nur das tun, was ihnen einprogrammiert und befohlen wurde. Wir müssen also die Menschen ändern und diese werden dann die Maschinen ändern - oder manche davon gar erst nicht bauen.

Und wenn Sie bis hierher gelesen haben, können Sie jetzt auch verstehen, warum ich in 60 Sekunden nie die berühmte Frage von Oma und Kind erschöpfend beantworten kann.

In den 60 Sekunden könnte ich höchsten eine Rede halten:

Meine Damen und Herren,

wir sind sehr stolz heute unser neuestes ethisches Modul für Roboter, KANT-500 vorstellen zu dürfen. Das Modul enthält die aktuellste künstlichen Intelligenz und proprietären Code, die sich im Labor am besten behauptet haben. Mit KANT-500 werden ihre Roboter immer im Sinne der höchsten gemeinschaftlichen Interessen handeln.

Die eingebaute Bewertungsfunktion erlaubt autonomen Fahrzeugen, blitzschnell Alter, Geschlecht, Beruf, Einkommen, Kontostand und medizinischen Zustand von, leider Gottes, noch unvermeidlichen Opfern im Straßenverkehr zu bestimmen. Seitdem weltweit das Tempolimit auf der Autobahn geächtet wurde und Tempo 100 überall in der Stadt möglich ist, ist KANT-500 für jedes Fahrzeug unerlässlich. Für jedes Menschenleben haben wir heute eine hochpräzise und vom TÜV zugelassene Bewertungsfunktion. Außerdem können Sie sich für einen kleinen monatlichen Beitrag mit dem BENTHAM-300 Plug-In bei uns anmelden und ein Zusatzbewertungsbonus für das eigene Leben erwerben. Über eine Cloud wird die Bewertungsfunktion immer mit den aktuellsten Daten versorgt. Ihre von der SCHUFA gemeldeten Schuldner werden selbstverständlich daran gehindert, ihren Schulden zu entkommen, es sei denn, die Erbmasse wäre ausreichend. Wir sind sicher, Sie werden höchst zufrieden sein und die Fahrt auf der Autobahn bei Tempo 200 voll genießen können.

Können Roboter lügen?

Essays von Raúl Rojas zur Robotik und Künstlichen Intelligenz

Als eBook bei Telepolis erschienen

Empfohlener redaktioneller Inhalt

Mit Ihrer Zustimmmung wird hier eine externe Buchempfehlung (Amazon Affiliates) geladen.

Ich bin damit einverstanden, dass mir externe Inhalte angezeigt werden. Damit können personenbezogene Daten an Drittplattformen (Amazon Affiliates) übermittelt werden. Mehr dazu in unserer Datenschutzerklärung.